Előfordult már, hogy egy barátodra bíztad személyes dolgaidat, és az véletlenül vagy szándékosan visszaélt velük? Akkor biztosan megérted, miért fontos, hogy az Apple® mindent megtesz annak érdekében, hogy az Apple-eszközök felhasználóiról ne lehessen magánjellegű adatokat gyűjteni. A mai digitális környezetben az adatvédelem az egyének és a szervezetek számára egyaránt kiemelkedően fontos kérdéssé vált. Mivel az adatvédelmi incidensek és az adatvédelem megsértése folyamatosan a címlapokra kerül, az érzékeny információk védelme elengedhetetlen. Az Apple, mint globális technológiai vezető vállalat, jelentős lépéseket tett ezen a területen a „Differential Privacy” innovatív megközelítésével.

A Differential Privacy, a gépi tanulás egyedülálló, az adatvédelmet előtérbe helyező módja

A gépi tanulás használata a szoftverek javítása céljából történő adatgyűjtéshez korántsem új keletű. Az Apple versenytársai, különösen a Google, szintén számos módszert vezettek be a felhasználói adatok gyűjtésére, amelyek segítenek szolgáltatásaik és alkalmazásaik személyre szabásában, ez azonban gyakran az adatvédelem rovására megy. Nagyon keskeny a határvonal a saját szolgáltatások fejlesztését szolgáló felhasználói adatgyűjtés és annak potenciális kockázata között, hogy ezeket a személyes adatokat veszélyes, vagy marketing célokra használják fel. Ha például a manapság a személyre szabott hirdetésekről szóló vitákat vesszük, akkor ez egyértelműen inkább veszélyt jelent a technikai eszköz és főként az okostelefon-felhasználókra nézve, mintsem előnyt, amely kényelmesebbé teszi a böngészést. Sokféle megközelítés volt arra, hogy az adatvédelemben megtalálják az arany középutat, miközben a felhasználói adatokon alapuló gépi tanulás is fejlődhessen. Az Apple Differential Privacy minden bizonnyal egy jól megtervezett megoldás erre a problémára.

A Differential Privacy komplex módszerstruktúrával rendelkezik, amely azon a gondolaton alapul, hogy az Apple az anonimizált tömeges adatok gyűjtése helyett három kulcsfontosságú elemet tartalmaz, amelyek hatékonyabb és értelmesebb eredményeket biztosítanak a szervezet számára, miközben továbbra is védik a felhasználók magánéletét. Először is, a hashing-módszert használja, amely a felhasználói adatokat átírja, hogy hatékony információkat és statisztikailag releváns eredményeket szolgáltasson anélkül, hogy eredeti, kényes információkat tárolna.

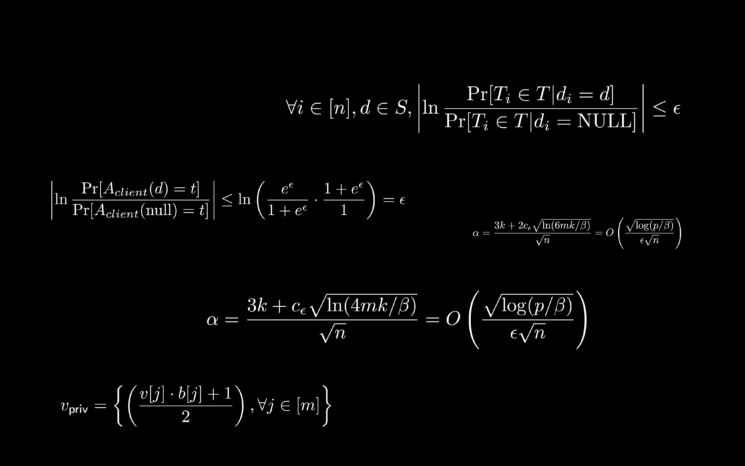

A hashing az adatokat egy sokkal rövidebb értékként titkosítja, ami így megkülönbözteti az eredeti értéktől. A másik módszer a sub-sampling, amely az eszközön tárolt adatokból von le hasznos meglátásokat, az adatokat viszont nem küldi el, így a privát adatok soha nem hagyják el magát az eszközt. A harmadik módszer a noise injection, amely az eredeti adathalmazhoz nem releváns adatokat is hozzáad, ezzel pedig sokkal randomizáltabb eredmény jön ki, amelyben az eredeti személyes adatok nem kinyomozhatóak. Természetesen a túl sok zaj erősen elferdíthetné a kimutatás eredményeit, ezért a kapott adathalmazt vissza kell redukálni. A noise injection torzítása visszaszámítható úgy, hogy statisztikailag hasznos eredményt kapunk anélkül, hogy megtudnánk mik voltak az eredeti privát adatok. A noise injection matematikai képlete a következő ábrán látható:

forrás: iDB

Ezenkívül ahelyett, hogy a folyamat a teljes mátrixot elküldené az Apple-nek, a generált mátrixnak csak bizonyos sorait választják ki az adatok kiértékeléséhez, ezzel még jobban biztosítva a privát adatok védelmét. Ez az úgynevezett Count Mean Sketch. Egy másik, még biztonságosabb módszer a Hadamard Mean Sketch, amely a mátrix egy sora helyett csak egy bitnyi adatot küld el.

Összegezve tehát a Differential Privacy azt jelenti, ha engedélyezzük, hogy az Apple készülék visszajelzéseket és diagnosztikai információkat küldjön az Apple vagy az AppStore alkalmazásfejlesztőknek, akkor az adatok módosításokon mennek át mielőtt az Apple készülék elküldi őket, hogy a fejlesztők számára így is hasznos információkat szolgáltasson a készülék, de közben ne legyenek visszakövethetőek a felhasználó személyes szokásai és adatai.

Természetesen, ha valaki nem szeretne semmilyen adatot megadni az Apple-nek, az adatgyűjtést a felhasználó teljesen kikapcsolhatja bármikor. Így azonban az Apple és az app fejlesztők nem kapnak visszajelzést, ami alapján fejleszthetnék a funkciókat. A Differential Privacy épp azt célozza, ne kelljen a felhasználónak tartania attól, hogy engedélyezze a visszajelzéseket az Apple számára.

Hol és hogyan használja az Apple a Differential Privacy-t?

Az Apple ezt a módszert több alkalmazás intelligens funkcióinak javítására vezette be, például a QuickType®, az emoji javaslatok, a Safari® és a Health Type. Ezek az alkalmazások megkapják az alaposan megszűrt és randomizált adatokat, törölve azokból a privát információkat. Amikor az Apple szervereire megérkezik, a kliens adatok nélkül összeömlesztik a sokfelől érkező visszajelzéseket. De még az így személytelenített és összeömlesztett adatokhoz is csak a felelős részleg férhet hozzá.

A módszer azért aggregálja az adatokat ezekből a forrásokból, hogy javítsa a javaslatokat, és akár visszajelzést is kapjon bizonyos fejlesztésekről, például arról, hogy a Health Type mennyire pontosan tudja mérni a felhasználói adatokat azáltal, hogy az alkalmazásban a felhasználó által szerkesztett adatok mennyiségére összpontosít, és nem a személyes adatok tényleges tartalmára, tehát látszik az eredményből, hogy melyik funkciókat kell fejleszteni még. A Safariban segít meghatározni, hogy mely deep linkek népszerűek vagy gyakran látogatottak anélkül, hogy a felhasználó személyazonosságát felfedné.

Mi a helyzet a vállalatokkal?

A fent részletezett megoldások hatékony módjai az Apple termékek és szolgáltatások fejlesztésének anélkül, hogy a felhasználókat adataik kiszivárgása fenyegetné. Első pillantásra talán kevésbé tűnik fontosnak a kérdéskör vállalati szinten, hiszen sokan azt gondolnák, hogy ez a téma inkább a hétköznapi Apple-felhasználókat érinti, mint a vállalkozásokat, ez azonban korántsem igaz! Sok cég és vállalat dönt úgy, hogy Apple munkaállomásokat ad alkalmazottainak, vagy engedélyezi a BYOD-konstrukciót különböző okokból, amelyeket már korábbi cikkeinkben is megvizsgáltunk. Az pedig vitathatatlan, hogy a legmeghatározóbb érv a munkahelyi Apple eszközhasználat mellett az a kiemelkedő biztonság és adatvédelem, amit az Apple biztosít. A munkavállalók rengeteg érzékeny adatot tárolnak okostelefonjaikon és számítógépeiken, azonban a legtöbben kevésbé szakmai célokra is használják a munkahelyi eszközeiket időnként.

Egy szerelő kaphat automatizált műszaki riasztásokat és üzeneteket az Apple Watch® óráján, de ugyanez az óra méri az egészségügyi adatait is. Egy értékesítő útközben szakmai célokra használja iPhone-ját vagy MacBook®-ját, de előfordulhat, hogy mellette személyes tartalmakat keres a Safariban, vagy üzeneteket küld barátainak és kollégáinak. A példák sorolását még lehetne folytatni, és ez a modern munkakörnyezet valósága, amely komoly és lelkiismeretes adatvédelmi megközelítést igényel, különben a bizalmas vállalati információk a munkavállaló személyes adataival együtt kiszivároghatnak. A vállalati környezetben használt funkciók fejlesztésének a segítése visszajelzésekkel viszont elemi érdeke a vállalatoknak.

Mivel azonban a Differential Privacy bevezetése már nem épp mai fejlemény, a jobb gépi tanulás iránti igény a fokozott és robusztus biztonsági intézkedésekkel együtt nagy ütemben növekszik, ezek a jól felépített módszerek elősegíthetik az adatvédelem jövőbeli fejlődését, miközben továbbra is a gépi tanulásra, a felhasználói élmény javítására és a hatékonyság növelésére összpontosítanak.